PRÁCTICA 2. 3D RECONSTRUCTION. MEJORA

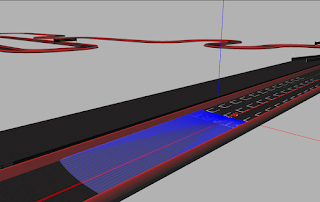

En la entrada anterior se puede ver que los resultados que se obtienen presentan bastante ruido, debido a malos emparejamientos. Por ello se ha tratado de mejorar los emparejamientos y filtrar los malos emparejamientos. Para ello se han modificado las siguientes cosas: 1- Los focos de luz que se habían introducido en el mundo de gazebo no se encontraban a la misma distancia de las cámaras. Esto provocaba que una cámara recibiera mayor iluminación que la otra. Para solucionar esto se han desplazado los focos de luz a la misma distancia. 2- Tras varias pruebas se ha visto que al filtrar los bordes, la imagen derecha no tenía exactamente los mismos bordes que la izquierda. Esto introducía errores. Por ello en la imagen derecha los valores de canny son menos restrictivos que los de la imagen izquierda para asegurarnos de que todos los bordes de la imagen izquierda estén en la derecha. Canny cámara derecha Canny cámara izquierda 3- Para realizar el emparejamiento